Fin da quando è diventata un fenomeno accessibile alle masse l’intelligenza artificiale ha creato aspettative assai elevate, tutte in qualche modo accomunate dall’idea di una vita più facile.

Trovare la ricetta per replicare il ragù della nonna, acquistare un volo al prezzo più basso, capire il significato di una parola sconosciuta (chessò, stocastico o ircocervo).

Oppure, spostandosi su un piano più concettuale, scrivere una tesi di laurea, progettare un business plan o una strategia di marketing, fare una ricerca e così via.

Si è capito abbastanza presto, tuttavia, che il presupposto di queste aspettative, che l’intelligenza artificiale desse sempre e soltanto risposte corrette, era sbagliato.

Abbiamo appreso, talvolta a nostre spese, che l’IA soffre di “allucinazioni”.

Il fenomeno colpisce in particolare l’IA generativa la quale, talvolta, percepisce modelli o oggetti inesistenti e fornisce risultati insensati o imprecisi.

Capita così che un utente, dopo avere digitato una domanda (in gergo prompt), ottenga una risposta che l’IA elabora senza fondarsi sui dati di addestramento oppure decodificandoli in modo errato o ancora senza seguire alcuno schema identificabile.

È un fenomeno ormai noto.

Le disgrazie, sfortunatamente, non vengono mai da sole e spesso sono l’una lo specchio dell’altra.

Ecco quindi spuntare un fenomeno parallelo che si potrebbe definire “allucinazione dell’utente”.

Seguono due casi reali che ne dimostrano l’esistenza.

…Il caso dell’avvocato che produce in giudizio un documento che riporta una sua conversazione con CHATGPT

Si è verificato presso il Tribunale di Ferrara.

La notizia è stata riportata da molti siti, tra i quali NT+Diritto con un articolo a firma dell’Avvocato Alberto Bozzo, “La conversazione con ChatGPT non è una prova”, nuovo caso di uso negligente dell’AI in Tribunale”,pubblicato l’11 marzo 2026 (a questo link per la consultazione), dal quale sono tratti i dettagli della vicenda riportati di seguito.

Il casus belli è stato creato da un avvocato che, in una controversia civile relativa ad un incidente stradale mortale incardinata dinanzi il Tribunale di Ferrara, ha prodotto come prova documentale una conversazione da lui avuta con ChatGPT.

Il giudice ha chiesto chiarimenti al legale che tuttavia si è limitato ad insistere per l’acquisizione del documento.

Non ha fatto altro, a questo punto, che emettere un’ordinanza in cui l’atto veniva considerato inesistente e quindi dichiarare inammissibile il ricorso con spese a carico del ricorrente assistito dal legale in questione.

Sono stati tre gli argomenti spesi dal giudice per motivare il suo provvedimento.

In primo luogo, la parzialità del documento dal quale mancava il prompt: si comprende bene che si tratta di una parte essenziale perché la domanda è in grado di condizionare la risposta e di orientarla nella direzione voluta dall’interrogante.

In secondo luogo, l’inconferenza dei precedenti citati nel documento che attenevano a questioni estranee alla natura e all’oggetto del giudizio.

Infine, la totale assenza di controlli sui precedenti medesimi, ad esempio attraverso il confronto con una banca dati giuridica, e quindi una negligenza elevata.

A questi tre argomenti il giudice ferrarese ha aggiunto considerazioni normative tratte dall’AI Act (Regolamento UE n. 2024/1689) e dalla Legge n. 132/2025 il cui art. 13, comma 2, obbliga i professionisti intellettuali ad informare i propri clienti ove intendano utilizzare sistemi di intelligenza artificiale.

Il legale di cui si parla non aveva fatto neanche questo.

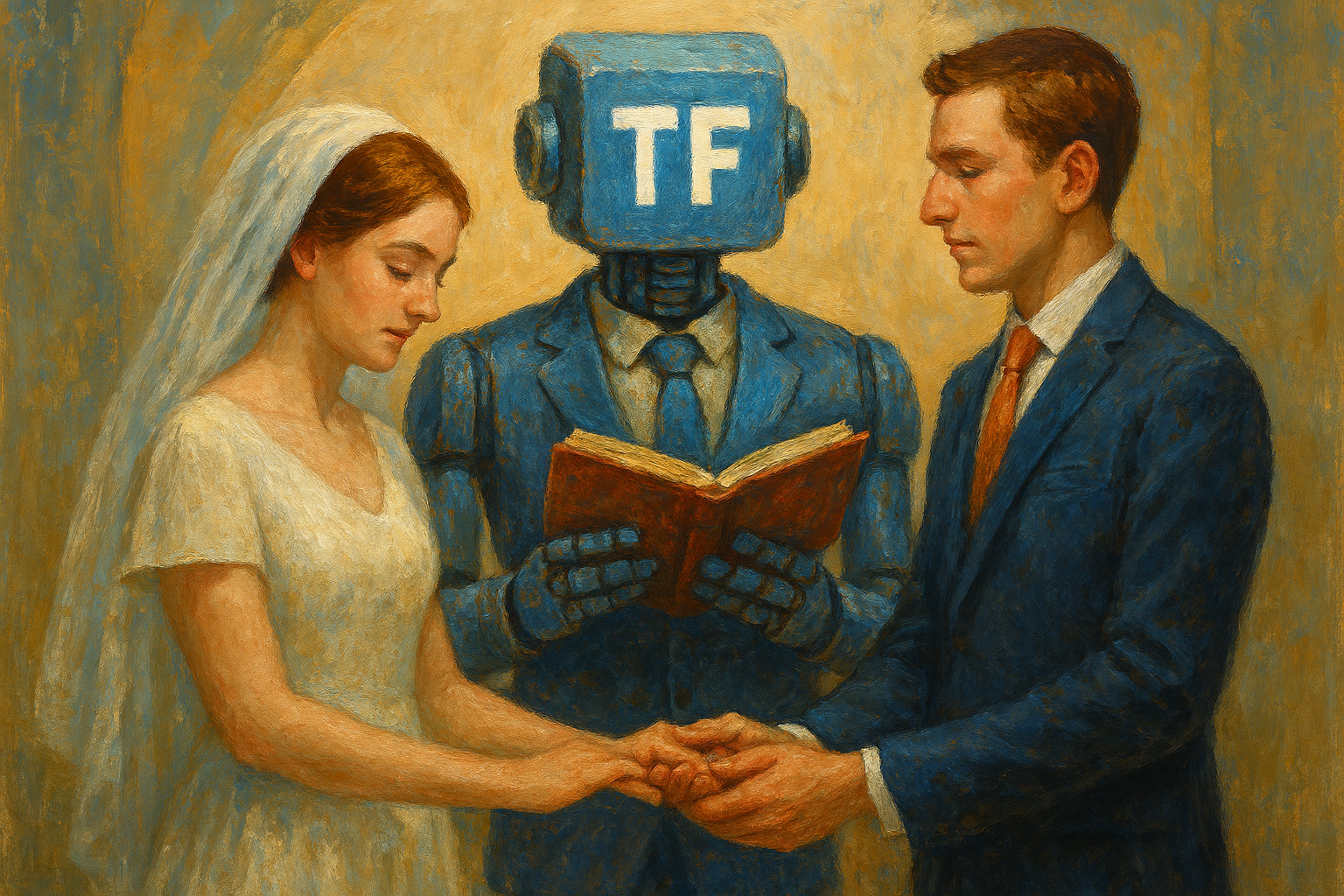

…Il matrimonio annullato a causa del discorso nuziale redatto con l’aiuto di CHATGPT

Questo secondo caso si è verificato nei Paesi Bassi e ne ha dato notizia l’agenzia AGI (a questo link per la consultazione).

La storia è presto raccontata.

Una coppia ha deciso di sposarsi e ha chiesto a un amico di celebrare il loro matrimonio con rito civile.

L’amico ha accettato e ha avuto la bella idea di chiedere a ChatGPT un aiuto per la stesura del discorso celebrativo.

In effetti, ha ottenuto quello che cercava e ne è venuto fuori un sermone allegro e fuori dagli schemi tanto che alla fine i nubendi sono stati dichiarati “non solo marito e moglie, ma prima di tutto una squadra, una coppia pazza, l’uno amore dell’altro e la casa dell’altro!“.

Bella frase, davvero, ma non è bastata a colmare una lacuna esiziale: si è scoperto infatti che nel discorso mancava la dichiarazione richiesta da un certo articolo del codice civile nederlandese che impegna i futuri sposi ad adempiere a tutti gli obblighi legali relativi al matrimonio, un po’ come i nostri artt. 143, 144 e 147 cod. civ.

Per effetto di questa prodezza il Tribunale competente ha annullato il matrimonio per la difformità del rito dal modello legale.

Si ignora se il matrimonio sia stato ripetuto, questa volta in modo ortodosso, o se i promessi sposi abbiano considerato l’incidente come un presagio funesto e abbiano lasciato perdere.

In conclusione

Un avvocato ha “parlato” con una IA e si è così invaghito della conversazione da tentare di trasformarla nella prova che gli avrebbe fatto vincere a man bassa la causa in cui patrocinava.

Un uomo cui era stato affidato un compito che implicava oneri formali lo ha delegato all’IA e lo ha riprodotto tale e quale.

Il primo ha perso miseramente la causa e mandato in fumo il dolore e gli interessi economici di chi ha subito la perdita di un congiunto.

Il secondo ha provocato l’annullamento di un matrimonio.

Sono senza dubbio allucinazioni anche queste e non della IA ma di chi la usa in modo che più sprovveduto non si può.